при методе наименьших квадратов параметры уравнения парной линейной регрессии

Метод наименьших квадратов регрессия

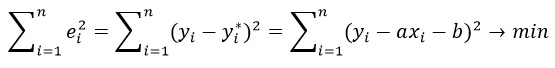

Метод наименьших квадратов (МНК) заключается в том, что сумма квадратов отклонений значений y от полученного уравнения регрессии — минимальное. Уравнение линейной регрессии имеет вид

y=ax+b

a, b – коэффициенты линейного уравнения регрессии;

x – независимая переменная;

y – зависимая переменная.

Нахождения коэффициентов уравнения линейной регрессии через метод наименьших квадратов:

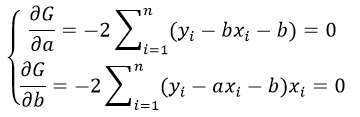

частные производные функции приравниваем к нулю

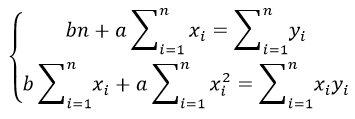

отсюда получаем систему линейных уравнений

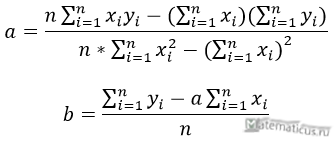

Формулы определения коэффициентов уравнения линейной регрессии:

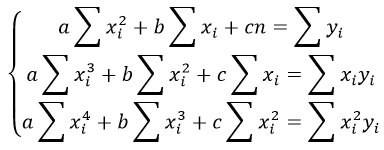

Также запишем уравнение регрессии для квадратной нелинейной функции:

Система линейных уравнений регрессии полинома n-ого порядка:

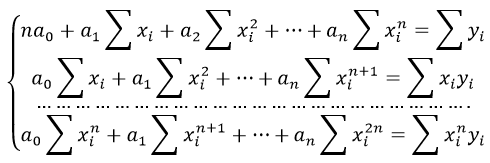

Формула коэффициента детерминации R 2 :

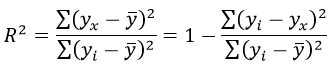

Формула средней ошибки аппроксимации для уравнения линейной регрессии (оценка качества модели):

Чем меньше ε, тем лучше. Рекомендованный показатель ε

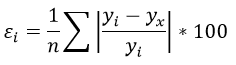

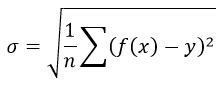

Формула среднеквадратической погрешности:

Для примера, проведём расчет для получения линейного уравнения регрессии аппроксимации функции, заданной в табличном виде:

| x | y |

| 3 | 4 |

| 4 | 7 |

| 6 | 11 |

| 7 | 16 |

| 9 | 18 |

| 11 | 22 |

| 13 | 24 |

| 15 | 27 |

| 16 | 30 |

| 19 | 33 |

Решение

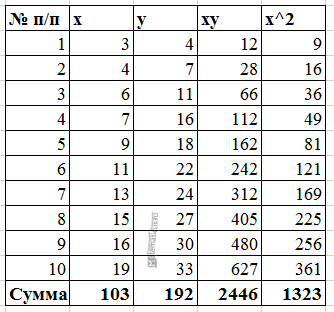

Расчеты значений суммы, произведения x и у приведены в таблицы.

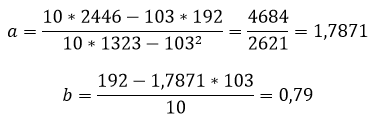

Расчет коэффициентов линейной регрессии:

при этом средняя ошибка аппроксимации равна:

ε=11,168%

Получаем уравнение линейной регрессии с помощью метода наименьших квадратов:

y=1,7871x+0,79

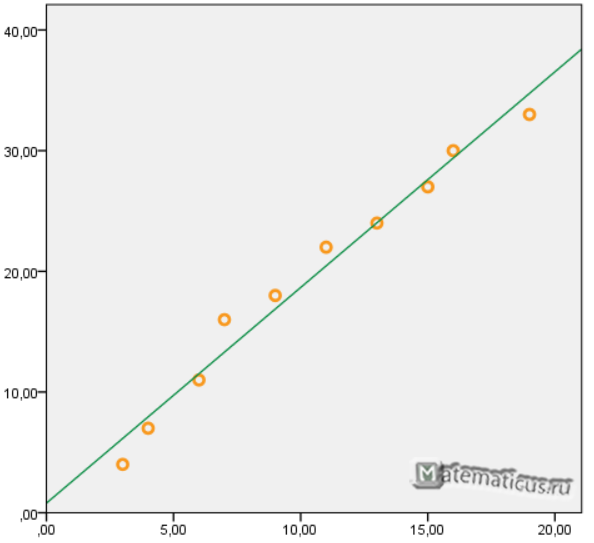

График функции линейной зависимости y=1,7871x+0,79 и табличные значения, в виде точек

Коэффициент корреляции равен 0,988

Коэффициента детерминации равен 0,976

Парная линейная регрессия. Задачи регрессионного анализа

Будут и задачи для самостоятельного решения, к которым можно посмотреть ответы.

Понятие линейной регрессии. Парная линейная регрессия

Если в результате наблюдения установлено, что при каждом определённом значении x существует сколько-то (n) значений переменной y, то зависимость средних арифметических значений y от x и является регрессией в статистическом понимании.

Если установленная зависимость может быть записана в виде уравнения прямой

то эта регрессионная зависимость называется линейной регрессией.

О парной линейной регрессии говорят, когда установлена зависимость между двумя переменными величинами (x и y). Парная линейная регрессия называется также однофакторной линейной регрессией, так как один фактор (независимая переменная x) влияет на результирующую переменную (зависимую переменную y).

В уроке о корреляционной зависимости были разобраны примеры того, как цена на квартиры зависит от общей площади квартиры и от площади кухни (две различные независимые переменные) и о том, что результаты наблюдений расположены в некотором приближении к прямой, хотя и не на самой прямой. Если точки корреляционной диаграммы соединить ломанной линией, то будет получена линия эмпирической регрессии. А если эта линия будет выровнена в прямую, то полученная прямая будет прямой теоретической регрессии. На рисунке ниже она красного цвета (для увеличения рисунка щёлкнуть по нему левой кнопкой мыши).

По этой прямой теоретической регрессии может быть сделан прогноз или восстановление неизвестных значений зависимой переменной по заданным значениям независимой переменной.

В случае парной линейной регрессии для данных генеральной совокупности связь между независимой переменной (факториальным признаком) X и зависимой переменной (результативным признаком) Y описывает модель

Уравнение парной линейной регрессии для генеральной совокупности можно построить, если доступны данные обо всех элементах генеральной совокупности. На практике данные всей генеральной совокупности недоступны, но доступны данные об элементах некоторой выборки.

Поэтому параметры генеральной совокупности оценивают при помощи соответствующих параметров соответствующей выборки: свободный член прямой парной линейной регрессии генеральной совокупности

В результате получаем уравнение парной линейной регрессии выборки

Чтобы уравнение парной линейной регрессии было более похоже на привычное уравнение прямой, его часто также записывают в виде

Уравнение парной линейной регрессии и метод наименьших квадратов

Определение коэффициентов уравнения парной линейной регрессии

Если через

Условие метода наименьших квадратов выполняется, если значения коэффициентов равны:

Пример 1. Найти уравнение парной линейной регрессии зависимости между валовым внутренним продуктом (ВВП) и частным потреблением на основе данных примера урока о корреляционной зависимости (эта ссылка, которая откроется в новом окне, потребуется и при разборе следующих примеров).

Решение. Используем рассчитанные в решении названного выше примера суммы:

Используя эти суммы, вычислим коэффициенты:

Таким образом получили уравнение прямой парной линейной регрессии:

Составить уравнение парной линейной регрессии самостоятельно, а затем посмотреть решение

Пример 2. Найти уравнение парной линейной регрессии для выборки из 6 наблюдений, если уже вычислены следующие промежуточные результаты:

Анализ качества модели линейной регрессии

Метод наименьших квадратов имеет по меньшей мере один существенный недостаток: с его помощью можно найти уравнение линейной регрессии и в тех случаях, когда данные наблюдений значительно рассеяны вокруг прямой регрессии, то есть находятся на значительном расстоянии от этой прямой. В таких случаях за точность прогноза значений зависимой переменной ручаться нельзя. Существуют показатели, которые позволяют оценить качество уравнения линейной регрессии прежде чем использовать модели линейной регрессии для практических целей. Разберём важнейшие из этих показателей.

Коэффициент детерминации

Коэффициент детерминации

Пример 3. Даны сумма квадратов отклонений, объясняемых моделью линейной регрессии (3500), общая сумма квадратов отклонений (5000) и сумма квадратов отклонений ошибки (1500). Найти коэффициент детерминации двумя способами.

F-статистика (статистика Фишера) для проверки качества модели линейной регрессии

Сумма квадратов остатков

Сумма квадратов остатков (RSS) измеряет необъясненную часть дисперсии зависимой переменной:

В случае качественной модели линейной регрессии сумма квадратов остатков стремится к нулю.

Стандартная ошибка регрессии

Стандартная ошибка регрессии (SEE) измеряет величину квадрата ошибки, приходящейся на одну степень свободы модели:

Чем меньше значение SEE, тем качественнее модель.

Пример 4. Рассчитать коэффициент детерминации для данных из примера 1.

Получаем коэффициент детерминации:

Таким образом, 83,6% изменений частного потребления можно объяснить моделью линейной регресии.

Интерпретация коэффициентов уравнения парной линейной регрессии и прогноз значений зависимой переменной

Итак, уравнение парной линейной регрессии:

Интерпретация свободного члена: a показывает, на сколько единиц график регрессии смещён вверх при x=0, то есть значение переменной y при нулевом значении переменной x.

Интерпретация коэффициента при независимой переменной: b показывает, на сколько единиц изменится значение зависимой переменной y при изменении x на одну единицу.

Пример 5. Зависимость частного потребления граждан от ВВП (истолкуем это просто: от дохода) описывается уравнением парной линейной регрессии

Если доход не меняется, то x i = 0 и получаем, что потребление уменьшается на 129,5338 у.е.

Задачи регрессионного анализа

Наиболее частые задачи регрессионного анализа:

Также делаются проверки статистических гипотез о регрессии. Кроме того, при изучении связи между двумя величинами по результатам наблюдений в соответствии с теорией регрессии предполагается, что зависимая переменная имеет некоторое распределение вероятностей при фиксированном значении независимой переменной.

В исследованиях поведения человека, чтобы они претендовали на объективность, важно не только установить зависимость между факторами, но и получить все необходимые статистические показатели для результата проверки соответствующей гипотезы.

Проверка гипотезы о равенстве нулю коэффициента направления прямой парной линейной регрессии

Если это предположение верно, то изменения независимой переменной X не влияют на изменения зависимой переменной Y: переменные X и Y не коррелированы, то есть линейной зависимости Y от X нет.

рассматривают во взаимосвязи с альтернативной гипотезой

Статистика коэффициента направления

Доверительный интервал коэффициента направления прямой линейной регрессии:

Пример 6. На основе данных из предыдущих примеров (о ВВП и частном потреблении) определить доверительный интервал коэффициента направления прямой линейной регресии 95% и проверить гипотезу о равенстве нулю коэффициента направления прямой парной линейной регрессии.

Можем рассчитать, что

Таким образом, стандартная погрешность коэффициента направления прямой линейной регресии b 1 :

Так как

Модель парной регрессии. Метод наименьших квадратов

Если теснота взаимосвязи значимая, необходимо построить количественное описание зависимости между экономическими показателями. Количественное описание зависимости между экономическими показателями называется регрессией.

Регрессия строится в виде модели регрессии или уравнения регрессии.

Если исследуется влияние одного экономического показателя x на другой экономический показатель y, то строится модель парной регрессии или уравнение парной регрессии.

Под парной регрессией понимают уравнение зависимости двух переменных:

x – независимая, объясняющая переменная (признак-фактор).

В отличие от функциональной зависимости x и y являются реализациями некоторых случайных величин, т. е. регрессию можно понимать как зависимость между случайными величинами. Задача регрессионного анализа – определение зависимости y от х в явном виде. По явному виду зависимости различают линейные и нелинейные регрессии.

Уравнение линейной регрессии имеет вид:

Коэффициент при независимой переменной b показывает, на сколько единиц в среднем изменится значение независимой переменной y при изменении независимой переменной x на единицу в среднем в принятых единицах измерения.

Коэффициент a не имеет четкой экономической интерпретации, он показывает значение зависимой переменной y при нулевом значении x. Можно интерпретировать знак свободы коэффициента a: если а >0, то относительное изменение зависимой переменной y происходит медленнее, чем относительное изменение независимой переменной x, если a

1)вид зависимости

2)независимые переменные xi – заданы без ошибок;

-ошибки

3)если независимых переменных x – несколько, то они некоррелированны (это называется отсутствием мультиколлинеарности);

4)последовательные значения ошибок или наблюдений должны быть некоррелированы (отсутствие автокорреляции ошибок или наблюдений).

МНК применим только для идентификации уравнения линейной регрессии. Чтобы использовать данный метод для идентификации уравнений нелинейной регрессии, необходимо линеаризовать уравнение нелинейной регрессии, т. е. путём тождественных математических преобразований привести его к линейному виду.